Эссе для тех, кто пропустил, но хотел бы знать

Сессия № 2: ИИ как помощник CIO, а не его замена Сессия посвящена практическому внедрению ИИ-агентов как «цифровых сотрудников» в работу ИТ-директора: какие задачи им можно делегировать, как настраивать и контролировать, а где человеческое решение незаменимо. Разберём оптимальные сценарии применения, границы доверия и типичные ошибки, чтобы ИИ усиливал CIO, а не создавал новые риски. из мероприятия

https://pvesna2026.4cio.ru/programs

Контекст: мы уже живём внутри взрыва

Открывая сессию, Михаил Малышев сразу задал масштаб разговора — не «что такое ИИ», а «где мы находимся прямо сейчас, весной 2026-го».

Скорость изменений в индустрии удваивается каждые 7 месяцев. К концу 2029 года существует обоснованная гипотеза, что ИИ сможет выполнять задачи, эквивалентные месячной когнитивной нагрузке одного самого умного человека на планете. По одной из метрик зрелости, AGI (Artificial General Intelligence) уже достигает 97% от уровня человека — остаток сужается на глазах.

Два индикатора этого взрыва, которые процитировал Малышев:

- Компания Anthropic за 52 дня выпустила 74 самостоятельных релиза — используя Claude Code, то есть ИИ, который пишет код для ИИ.

- Платформа Hugging Face уже содержит почти 3 миллиона моделей и порядка миллиона датасетов.

Но главный тезис открытия был практическим: разница между «просто использовать модель ИИ» и «работать с агентской системой» — это разница в пользе примерно в два раза. Большинство CIO в зале всё ещё находится на первом уровне. Цель сессии — показать следующие ступени.

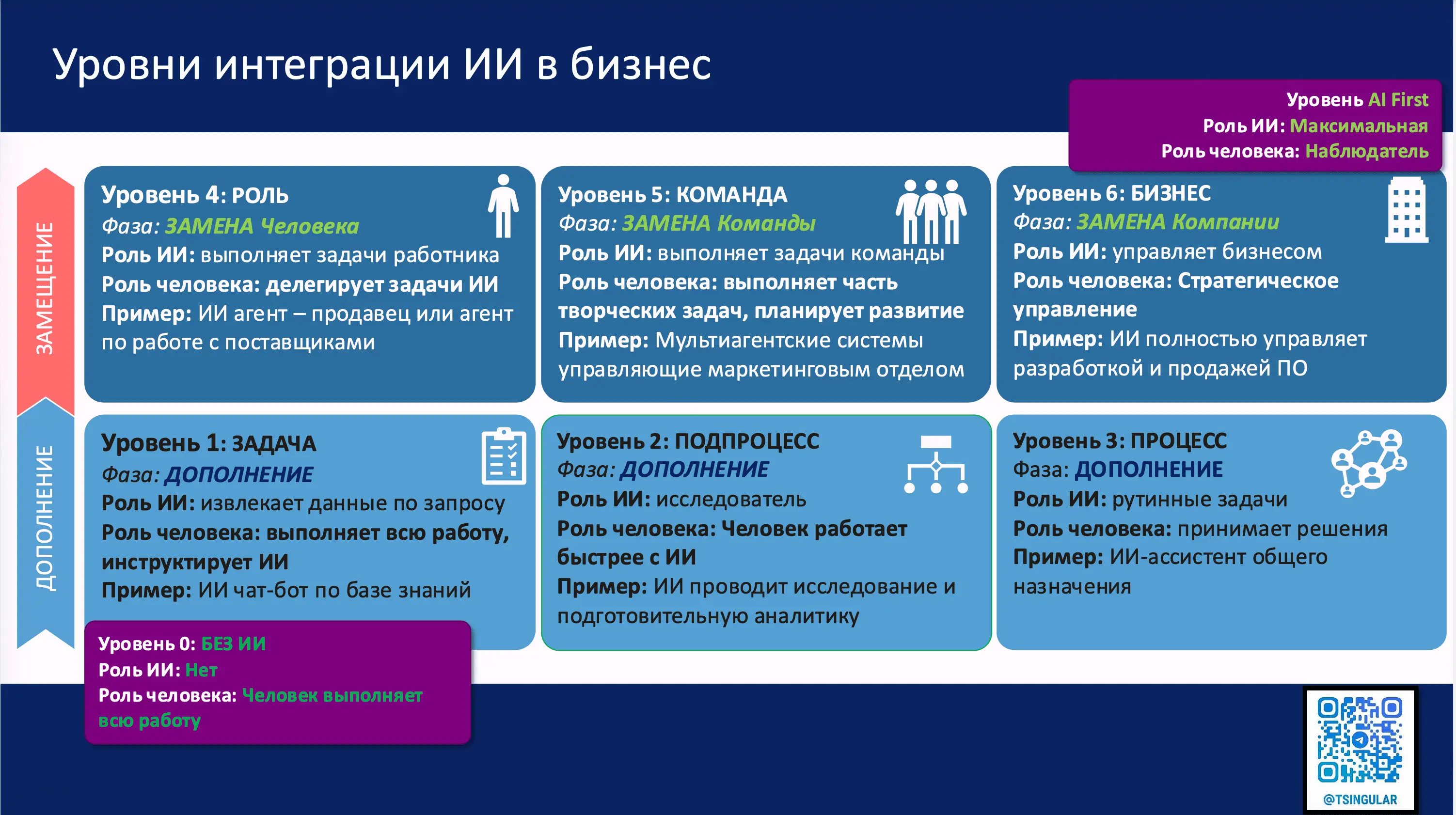

Шесть уровней зрелости: от чата до цифровой компании

Михаил Малышев представил шкалу зрелости применения ИИ в работе ИТ-директора — от нулевого до максимального уровня автоматизации.

История нашумевшего OpenClaw — сама по себе иллюстрация той скорости, о которой говорил Малышев. В ноябре 2025 года его как личный проект написал в одиночку австрийский разработчик Питер Штайнбергер. До февраля система существовала тихо — пока Anthropic не анонсировал собственного настольного агента. Китайцы немедленно переписали аналог в open source, он начал вируситься и сменил три названия — Clawdbot, Moltbot и наконец OpenClaw. В России его называют «Краб», хотя на логотипе изображён лобстер.

Никто из десятков появившихся клонов так и не смог его превзойти. 15 февраля 2026 года Сэм Альтман объявил, что Штайнбергер переходит в OpenAI руководить разработкой агентов следующего поколения — проект при этом остался open source под управлением независимого фонда. Принципиальное отличие, которое выстрелило: OpenClaw умеет самостоятельно создавать для себя новые навыки из любой абстрактной задачи. Не просто выполнять — а расширять собственные возможности под задачу. После этого весь рынок шагнул в ту же сторону.

К лету 2026 крабы шагнут в реальный мир - появятся OpenClaude-агенты в физическом воплощении — уже встроенные в роботов-платформу Unity 3.

Боли CIO глазами управляющей компании

Анна Коротченкова, вице-президент по технологиям АФК «Система» (управляет 35 портфельными компаниями: Ozon, МТС, Segezha, NaturaSiberica и другими), рассказала о том, что боли CIO не меняются, но к ним добавились новые требования.

Классические боли CIO в 2026 году:

- Управление инфраструктурой и технологическим долгом

- Ручной сбор данных из разнородных систем

- Запросы «сверху вниз» — акционеры что-то услышали и хотят внедрения «ещё вчера»

- Необходимость показывать ROI от каждого внедрения, а не «умозрительную пользу»

- Когнитивный диссонанс: оптимизировать расходы и одновременно развивать собственные альтернативы западным решениям

Отдельно Анна подняла тему сопротивления на местах: водители на шахтовом комбинате разбивали GPS контроллеры и камеры, когда система мониторинга маршрутов угрожала их должности. Это не история из прошлого — это повторяется везде, где внедряются новые технологии, которые конфликтуют со старыми укладами. И это грозит повторится когда ИИ будет выходить за пределы офиса.

Что сделала АФК: агент над 120 000 проектами

Для управления R&D-активностью в периметре 35 компаний АФК подключила агентов к государственной базе ЕГИС НИОКР (120 000+ научных и исследовательских проектов).

Практический результат — реальный кейс: запрос на поиск команд для предиктивного обслуживания оборудования в металлургии. Традиционный путь: 2–3 недели (опрос контактов → поиск интеграторов → переписка → шортлист). С агентом: 10–15 минут → 10–12 ранжированных команд по нужным фильтрам (бюджет, опыт, стадия, наличие кейсов в Северстали и НЛМК) → презентация к концу дня.

Принципиальный вывод Анны: крупные корпорации смотрят на ИИ как на подсказчик, а не как на ЛПР. Стратегические решения, оценка рисков с учётом реалий бизнеса, баланс запросов разных функций — всё это остаётся за человеком.

Структурная устойчивость (Structural Robustness): как строить ИИ-системы, которым можно доверять

Самый технически глубокий доклад сессии сделал Александр Червяков из Федерального казначейства — организации, через которую проходят все бюджетные деньги страны.

Казначейство разработало мультиагентную систему анализа рисков ~4000 мероприятий национальных проектов. Текущая точность — 96% идентификации мероприятий, которые не будут выполнены в срок.

Проблема, которую решали: «голый» LLM-оркестратор в мультиагентной системе неустойчив. Он «заблуждается» при:

- Неправильно сформулированном вопросе

- Данных из доменной области, на которой не обучался

- Деградации параметров стенда

- Галлюцинациях при генерации

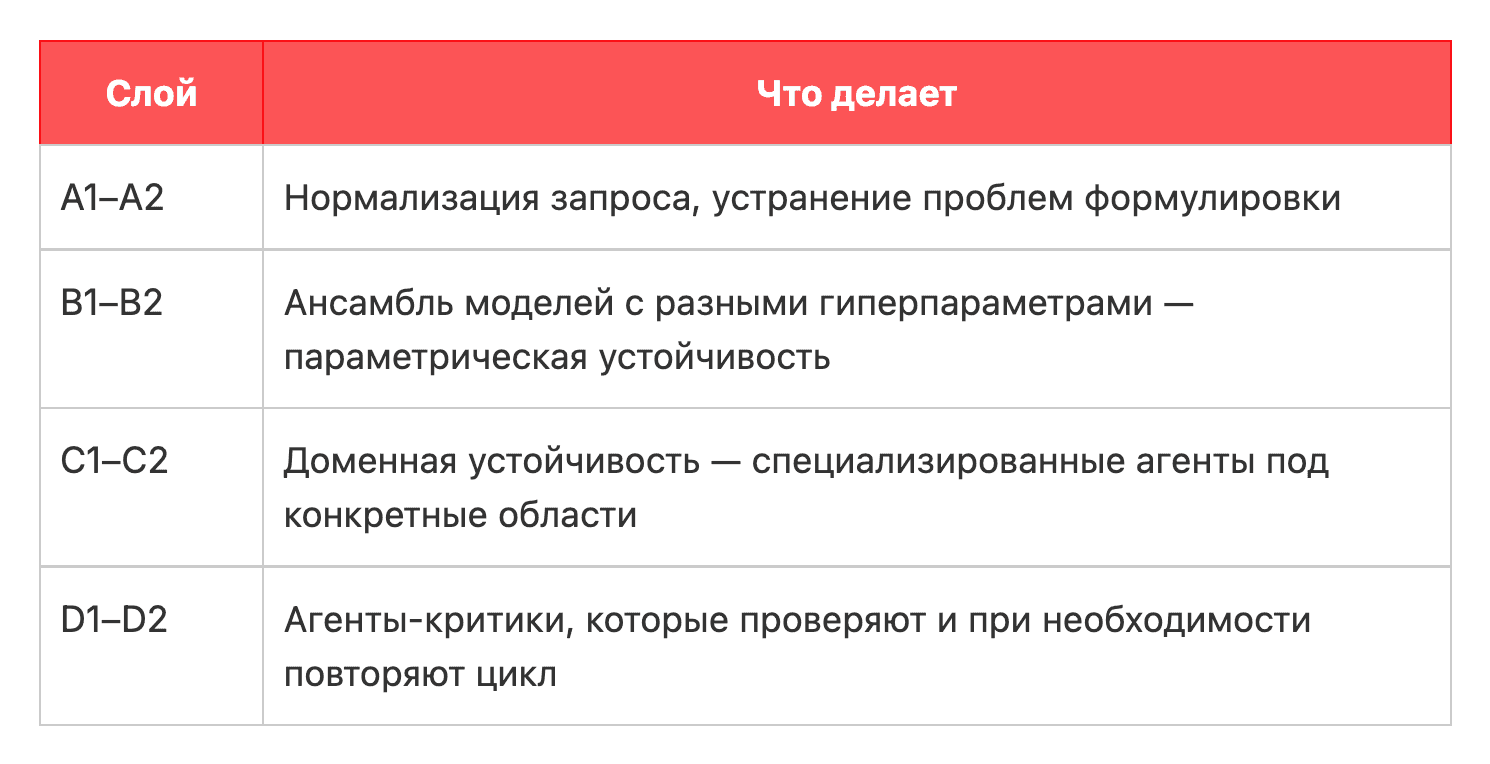

Решение — концепция структурной устойчивости (Structural Robustness) — четырёхслойная архитектура:

Практический лайфхак для любого CIO: даже один агент-критик в конце цепочки, которому даётся задание «раскритикуй этот ответ и подсвети узкие места», повышает устойчивость всей конструкции примерно на 30%.

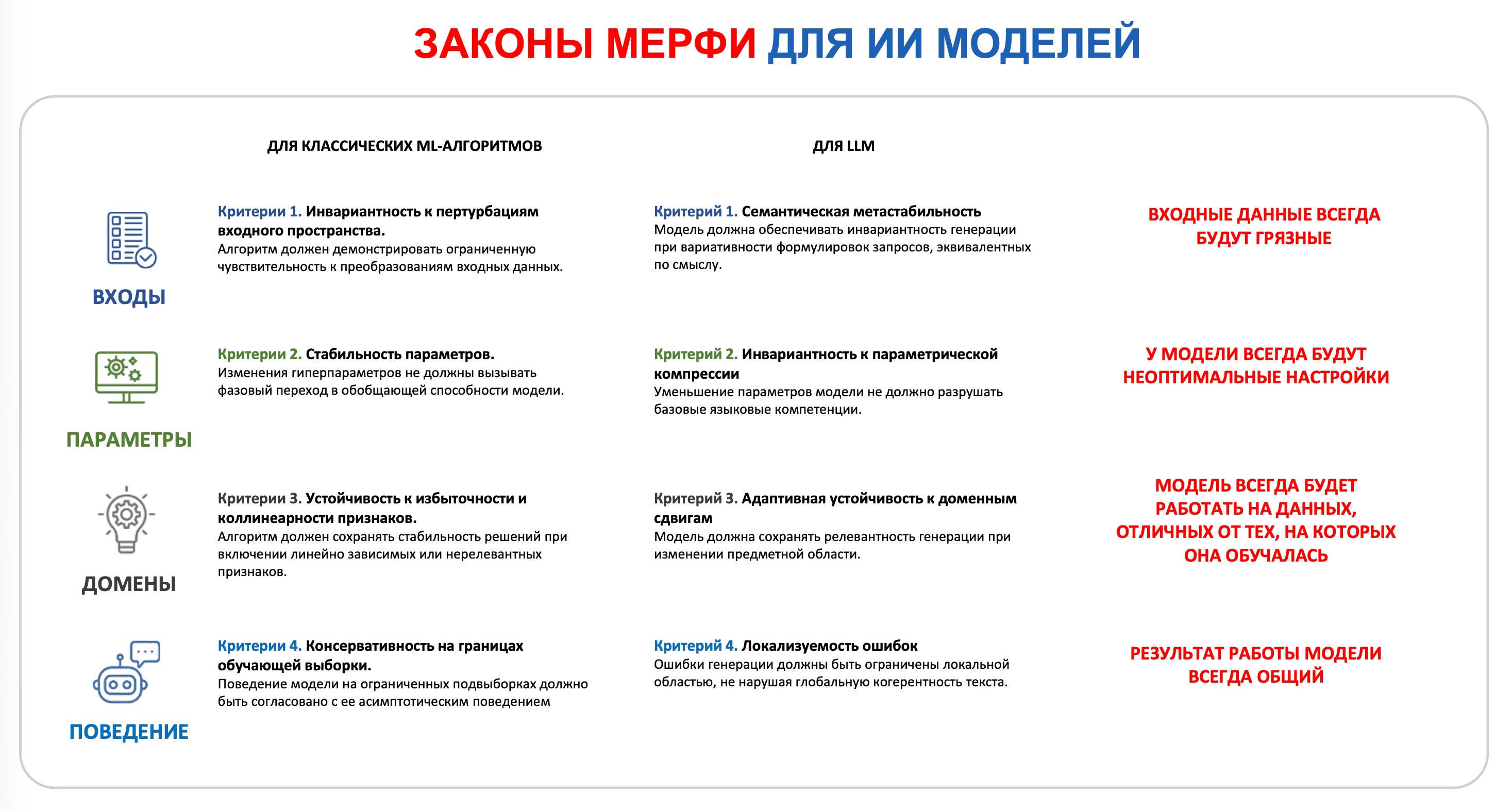

Закон Мёрфи для ИИ-систем от Червякова (с долей юмора, но по сути точно):

- Входные данные всегда будут грязными — смириться

- Оптимальные гиперпараметры никогда не будут найдены

- Модель всегда работает на данных, отличных от тех, на которых обучалась

- Модель всегда выдаёт результат — никогда не выдаёт точный результат

Ключевой принцип Казначейства: все конечные решения принимает человек. ИИ-система — это система поддержки принятия решений (СППР), которая уведомляет, но не решает.

Переосмысление бизнес-процессов: агенты требуют другой организации

Дмитрий Гуреев поднял неочевидную проблему, с которой сталкиваются почти все: традиционный бизнес-анализ и классическая организация процессов разработки систем автоматизации не работают при проектировании агентных систем.

Его тезис: революция начинается, когда ты переосмысляешь саму структуру работы, а не просто подставляешь ИИ вместо человека на старые операции.

Пример — написание книги. Он и его коллега начали писать свои книги в прошлом году

- Его коллега-эксперт пишет новую книгу - как обычно - страницу за страницей, быстрее обычного, потому что использует GPT. И всё еще продолжает писать.

- Дмитрий Гуреев упаковал книгу за 3 месяца (обычный срок — 2 года), но для этого ему пришлось радикально пересобрать процесс мышления себя как автора-писателя, выдумать новый процесс написания книги с использованием ИИ-агентов.

Граница доверия очевидна: «Если ты руками сам не умеешь, если у тебя нет плана — никакой ИИ за тебя ничего не сделает». ИИ — инструмент для коротких шагов, а на длинной длинной дистанции нужно полностью пересобирать процесс.

ИИ в команде разработки и вопросы безопасности

Дмитрий Иншаков, CIO с командой ~150 человек, описал практику, которая уже стала нормой:

- Практически вся команда разработчиков пишет код с ИИ. Разница между «лидерами» и «догоняющими» — в модели использования, а не в инструменте

- Code Review через трёх параллельных агентов с разных сторон + агент-оркестратор делает итоговое саммари → человек финально проверяет

- Нейрошлюз / AI-хаб для работы с внутренними моделями, чтобы не выносить данные клиентов за периметр

По безопасности — отдельный акцент: Prompt Injection (атаки через встроенные инструкции в данных) — уже реальная угроза, особенно для новых, только что написанных инструментов. Функция CIO как «скептика с guardrails» становится не менее важной, чем функция «амбассадора ИИ».

Что нельзя делегировать агентам: человеческое незаменимо

Несколько ораторов независимо пришли к одной и той же карте «необсуждаемых зон», где решение остаётся за CIO:

- Стратегические решения — ИИ не видит контекст организации за горизонтом нескольких запросов

- Оценка рисков в неопределённости — адаптивность к реальным условиям бизнеса

- Управление сопротивлением изменениям — только человек договаривается с водителями, которые разбивают оборудование

- Финальная валидация результатов — ИИ всегда выдаёт результат, никогда — гарантированно точный

- Долгосрочная логика — модели теряют вектор через несколько запросов, человек держит стратегию

Итоговый вывод сессии

Если сформулировать главный тезис всех выступлений одной фразой — это не название сессии, а его уточнение:

ИИ уже сегодня способен взять на себя до 60–70% рутинных информационно-аналитических задач CIO. Но каждый процент автоматизации требует нового уровня архитектурной дисциплины, доменной экспертизы и человеческого контроля на выходе.

Весна 2026-го — это не год экспериментов. Это год, когда от CIO ждут масштабирования. И как сказала Анна Коротченкова: «Часть задач может взять на себя ИИ. Но это не снимает уровень экспертизы человека, который в конечном счёте валидирует всё, что мы получаем».

Комментарии (0)