Когда государство начинает регулировать технологию, первые три реакции у всех одинаковые.

- У граждан: «ну и ладно».

- У бизнеса: «опять бумаги».

- У ИТ-директора: «к нам это не относится».

Все три реакции неверные.

Проект федерального закона «Об основах государственного регулирования сфер применения технологий искусственного интеллекта в Российской Федерации» — это не очередная декларация о добрых намерениях. Это первый в истории России документ, который юридически описывает, кто вы такой в мире ИИ, что вы обязаны делать, кто вас проверит — и что будет, если вы этого не сделали.

Основные смыслы для дискуссии:

- Закон создаёт тройную цепочку ответственности за "ошибки ИИ": разработчик → оператор → пользователь. Тут нет строгой линейной очередности ответственности в духе «сначала отвечает разработчик, а если не он — то оператор». Вместо этого закон устанавливает принцип распределённой, долевой ответственности, где каждый отвечает соразмерно своей вине, но для создателей и владельцев ИИ фактически вводится презумпция виновности

- «Суверенность» модели — новый критерий допуска к госзаказу, потенциально барьер для иностранных решений

- Большинство норм работает через отсылки к будущим подзаконным актам, что создаёт регуляторную неопределённость сейчас

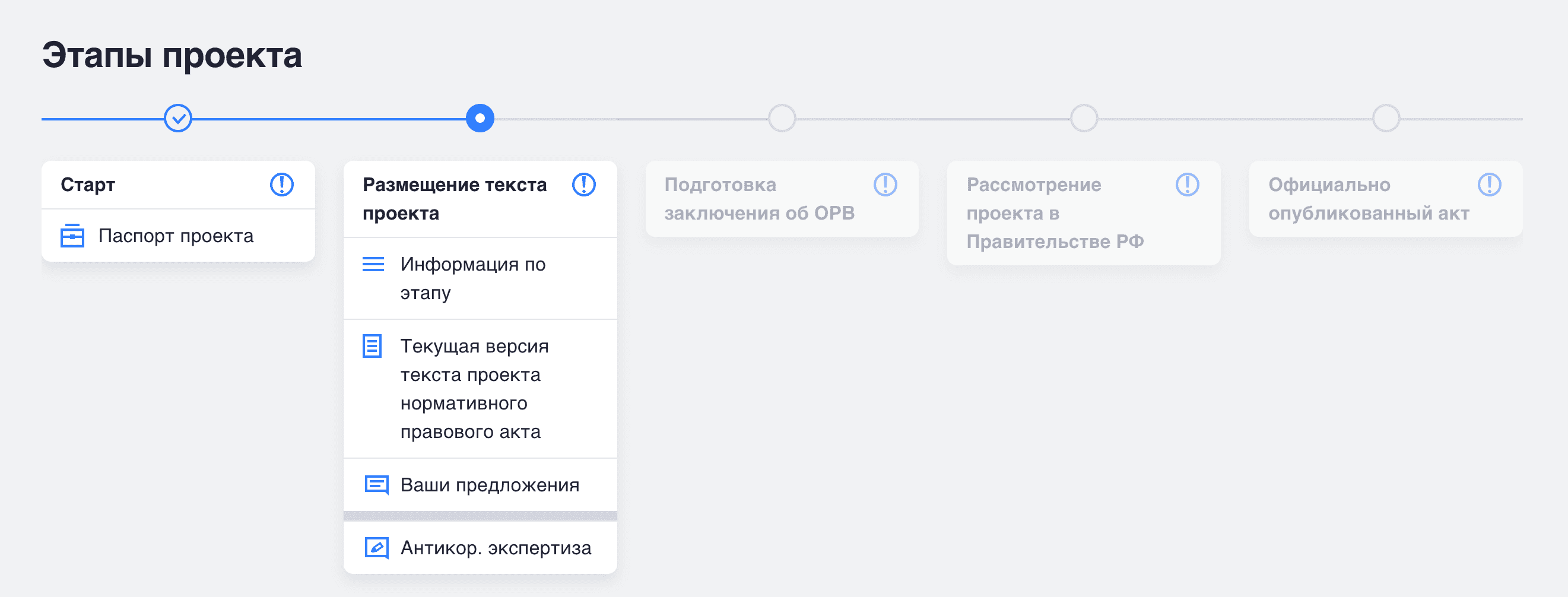

Сначала — о статусе

Это проект. По плану публичное обсуждение должно закончиться 15 апреля 2026 года, затем он поступит в Госдуму. Планируемая дата вступления в силу — 1 сентября 2027 года. Но примерно треть его положений заработает не с принятием закона, а с выходом подзаконных актов Правительства и ведомств — а их ещё нет. Так что сейчас мы имеем дело с картой будущей территории.

Уметь читать карту полезно уже сейчас.

Если вы обычный человек, которого пользует ИИ

Закон впервые прямо определяет: у вас есть права. Перечислим честно — и что за ними стоит.

Право знать об ИИ. Если ИИ продаёт вам что-то или принимает решение без участия человека — вас обязаны предупредить об этом. Звучит просто. На практике: требования к формату предупреждения определит Правительство. Когда и как — узнаем из подзаконных актов видимо.

Право отказаться от услуг с ИИ. В «случаях, устанавливаемых Правительством» вы можете потребовать сервис без ИИ. Пока этих случаев ноль, потому что Правительство их ещё не установило. Когда банк откажет вам по скоринговой модели — попросить «живого человека» юридически значимым способом пока нельзя. И вот мне прямо очень сомнительно - что реальные бизнесы смогут выполнить через год услуги без ИИ и остаться конкурентосособными... Это прямо как уже сейчас - нужно пройти спецчеллендж, чтобы добраться до живого человека из поддержки сотового оператора. Дальше челлендж будет только усложняться

Право обжаловать решения ИИ. Досудебно — только для решений госорганов, госучреждений и компаний с госучастием. Частная страховая, маркетплейс, агрегатор — живут по-старому. До специального порядка.

Право на компенсацию вреда в результате ошибок ИИ — есть, через гражданский кодекс. То есть: суд, доказывание, юрист, годы.

Маркировка дипфейков и синтезированного контента — теперь будет обязательной. Если вам присылают фейковое видео без пометки «сгенерировано ИИ» — это уже нарушение. Крупные платформы (от 100 тыс. пользователей в сутки - Daily Active Users, DAU) будут обязаны такую маркировку проверять и добавлять. Удалять дипфейки — если не нашли, кто добавит пометку.

Главный практический вывод для пользователя: закон создаёт контур защиты, но кнопка «включить» на большинстве опций будет нажата Правительством позже. Ваша задача сейчас — знать, что эти права существуют, и требовать их реализации по мере выхода подзаконных актов.

Если вы оператор ИИ-системы

«Оператор» по закону — это тот, кто эксплуатирует систему. Не разработал, не продал — именно эксплуатирует. В крупной компании это часто ИТ-подразделение или владелец внутреннего продукта. И именно на вас ложится самая неудобная часть закона.

Вы обязаны:

— включить в документацию руководство по безопасной эксплуатации с явным запретом на манипуляции и эксплуатацию уязвимостей пользователей;

— тестировать систему на возможность незаконного использования;

— вести учёт инцидентов;

— назначить ответственных за безопасность;

— незамедлительно приостановить эксплуатацию при угрозе вреда жизни, здоровью, имуществу или безопасности государства — и уведомить уполномоченный орган «в срок и порядке, определяемом Правительством».

Последний пункт — юридическая мина. Порядка уведомления ещё нет. Критерии «угрозы вреда» — не определены. Зато ответственность уже есть: закон прямо говорит, что разработчик, оператор и владелец несут ответственность, если они «заведомо знали или должны были знать» о возможности незаконного результата. Должны были знать — это не про умысел. Это про то, как суд оценит вашу осмотрительность постфактум.

Главный практический вывод для оператора: начните оформлять то, что у вас есть как «не документы», в реальные документы. Журнал инцидентов, матрица ответственных, процедура остановки, архитектурное описание ограничений модели. Не потому что уже штрафуют — а потому что в момент первого инцидента у вас будет органиченное время на реакцию, а не годы на подготовку.

Если вы CIO или CDTO

Для вас этот закон — это прежде всего изменение архитектурных ограничений. Не технических — регуляторных. И они сложнее.

Реестр доверенных моделей. Для государственных информационных систем и значимых объектов критической информационной инфраструктуры (КИИ) — только модели из реестра. Попасть в реестр: подтвердить соответствие требованиям безопасности (ФСТЭК + ФСБ), обеспечить обработку данных исключительно в РФ, подтвердить качество у отраслевого регулятора. Параллельно, у каждого. Порядок ещё разрабатывается.

Суверенные и национальные модели. Закон говорит прямо: поддерживать будут именно их. Определение: разработка в РФ, обучение в РФ, данные из РФ, разработчик — российское юрлицо с российским контролем более 50% голосов. Правительству дано право определять случаи их обязательного применения.

Что это значит для вашего ИТ-ландшафта: GPT-обёртка на Azure или open-source модель, дообученная командой с иностранными соучредителями, — это не суверенная модель. Завтра она может оказаться вне зоны допустимого для вашего отраслевого контура.

Архитектурное документирование. Разработчик обязан документировать «архитектуру, логику функционирования и ограничения модели в объёме, необходимом для её проверки». Проблема: у современной нейросети с миллиардами параметров нет «логики функционирования» в человекочитаемом виде. Что будет считаться «достаточным объёмом» для проверки — решит правоприменение. Читай: первые несколько судебных прецедентов.

Тройное согласование. Любой нормативный акт по ИИ: уполномоченный орган (Минцифры) + ФСТЭК + ФСБ. Скорость регуляторного производства равна скорости самого медленного и консервативного участника.

Главный практический вывод для CIO/CDTO: разделите свой ИИ-портфель на четыре класса прямо сейчас. (1) Внутренние помощники. (2) Внешние клиентские сервисы. (3) Системы, влияющие на юридически значимые решения. (4) Системы для ГИС/КИИ. Комплаенс-нагрузка растёт от первого к четвёртому экспоненциально. Для четвёртого класса закладывайте бюджет на регуляторную подготовку как отдельную статью — наравне с лицензиями и инфраструктурой.

Если вы CEO, владелец сервиса или разработчик модели

Закон вводит подробную матрицу обязанностей для трёх ролей — разработчик модели, владелец сервиса, оператор системы. Если вы стартап — вы, скорее всего, все три сразу.

Для разработчика модели:

- документировать архитектуру и ограничения в объёме, достаточном для проверки регулятором;

- исключить функциональные возможности, которые могут дискриминировать пользователей по их поведению или личным характеристикам;

- проводить моделирование потенциальных рисков с учётом предполагаемого применения;

- информировать о невозможности использования модели в запрещённых целях.

Для владельца сервиса:

- явно запретить в правилах доступа использование сервиса в целях, противоречащих законодательству;

- внедрить механизмы, ограничивающие создание незаконного контента;

- информировать пользователей о взаимодействии с ИИ (кроме случаев, когда это очевидно из назначения сервиса);

- если суточная аудитория — более 500 тыс. пользователей из РФ, выполнять требования для значимых информационных посредников (статья 10.1 ФЗ «Об информации»);

- обеспечить маркировку синтезированного контента.

Главный практический вывод для владельца и разработчика: ваши документы — это ваша первая линия защиты. Пользовательское соглашение, правила доступа, лицензионный договор, предупреждение об ИИ, политика маркировки, описание ограничений модели — всё это должно быть не «юридической формальностью», а рабочим инструментом. Обновите их до вступления закона в силу, а не после первого иска.

Для всех: закон разрешает использовать охраняемые объекты для обучения моделей при условии правомерного получения и доведения до всеобщего сведения. Это хорошая новость. Плохая: ответственность за нарушение прав третьих лиц возлагается на пользователя и владельца сервиса — а не абстрактно «на закон».

Самая тихая революция в законе: ваши данные кормят ИИ — и это правильно

Пока публика обсуждала маркировку дипфейков, в пятой части тринадцатой статьи тихо проходит норма, которая переписывает основы российского авторского права. Предлагаемый закон об ИИ прямо говорит: использование охраняемых произведений для обучения ИИ не является нарушением авторских прав, если разработчик получил правомерный экземпляр или материал был доведён до всеобщего сведения. Проще говоря: если ваша статья, книга или фотография опубликованы в открытом доступе — их можно скармливать модели без вашего согласия и без вознаграждения.

И знаете что — это правильно, и Россия здесь оказалась смелее многих. В ЕС аналогичная норма (TDM-исключение в DSM Directive) обросла громоздким механизмом машиночитаемых запретов, которым пользуются крупные издатели, но не рядовые авторы. В США вопрос до сих пор решается в судах — OpenAI и другие компании участвуют в десятках исков. Россия выбрала японскую модель: чистое разрешение без бюрократии opt-out, потому что прогресс важнее охранительного рефлекса. Пока европейские регуляторы строят заборы вокруг данных, российские разработчики получают легальный доступ к огромному корпусу русскоязычного контента для обучения суверенных моделей. Это не недосмотр — это осознанный выбор в пользу конкурентоспособности.

ЕС регулирует то, что ИИ делает. Россия — то, кто его сделал

Когда в 2024 году вступил в силу EU AI Act, Европа выстроила четырёхуровневую пирамиду риска:

- Неприемлемый риск — запрещено полностью. Социальный скоринг граждан государством, манипулятивный ИИ, биометрическая идентификация в реальном времени в публичных местах. Не «нужна лицензия» — именно «запрещено».

- Высокий риск — разрешено при жёстком комплаенсе. Медицинские устройства, системы кредитного скоринга, управление критической инфраструктурой, системы подбора персонала, образовательные решения — всё, что влияет на права конкретного человека.

- Ограниченный риск — разрешено с обязательством прозрачности. Чат-боты обязаны сообщать, что они — ИИ.

- Минимальный риск — можно всё, добровольные кодексы.

Главный вопрос для регулятора — какой вред может нанести конкретная система конкретному человеку, независимо от того, кто и где её создал. Немецкий стартап и американский гигант подчиняются одним правилам, если их ИИ работает с европейцами.

Российский проект задаёт другую ось: не риск, а происхождение. Суверенная модель — разработана в России, гражданами России, на российских данных — получает приоритет господдержки и привилегированный доступ к госсектору вне зависимости от того, что именно она делает.

Это не означает, что российский подход «хуже». Это означает, что он решает другую задачу:

- ЕС строит защиту граждан от последствий ИИ.

- Россия строит защиту государства от зависимости от иностранного ИИ.

Обе задачи реальны. Но компании, работающие на обоих рынках, получают принципиально несовместимые требования: для ЕС важно что делает ваша система, для России — кто и где её создал.

Для CIO, работающего на обоих рынках, это означает неустранимый двойной комплаенс: то, что делает систему «доверенной» в России, не делает её compliant в ЕС — и наоборот. Две философии, два несовместимых чек-листа.

Регуляторный Уроборос

Есть парадокс, который стоит назвать прямо.

«Регуляторный Уроборос»: закон декларирует ускорение развития ИИ, но архитектурно воспроизводит логику всех предыдущих российских цифровых законов — от суверенного интернета до обязательной предустановки ПО. Компании с ресурсами для прохождения многоступенчатых согласований (реестр + ФСТЭК + ФСБ) получают конкурентное преимущество не через качество продукта, а через compliance-мощность.

Архитектура закона создаёт многоступенчатый фильтр: реестр доверенных моделей, требования суверенности, тройное согласование НПА, обязательное документирование, режим допуска к госсектору. Пройти этот фильтр смогут компании с ресурсами на долгие согласования, опытными юристами в сфере ИБ и связями с профильными ведомствами.

Это не конспирология и не критика ради критики. Это системный эффект: когда барьеры входа высоки, рынок концентрируется вокруг тех, кто их преодолел. История российского регулирования цифрового рынка — от обязательной предустановки ПО до реестров значимых ресурсов — знает этот сценарий хорошо.

ЭПР: как новый закон приземляется на уже занятую посадочную полосу

Пока Минцифры готовило новый важный рамочный закон об ИИ, Россия несколько лет уже работала в другой системе координат: экспериментальных правовых режимах (ЭПР). Это «регуляторные песочницы» — специальные правовые пузыри, в которых компании могут тестировать технологии, временно отступая от общих норм. К 2026 году в России насчитывается 15 действующих ЭПР, охватывающих беспилотный транспорт, телемедицину, дрон-доставку и другие сферы. Правовая база — ФЗ-258 от 2020 года «Об экспериментальных правовых режимах в сфере цифровых инноваций».

Пионером стала Москва: с 1 июля 2020 года здесь действует первый ЭПР в сфере ИИ, который изначально был запущен на пять лет как «пилот, а не вечная история». В его рамках компании могли работать с биометрией, медицинской диагностикой и системами видеонаблюдения по специальным, облегчённым правилам.

Теперь появляется рамочный закон. Возникает закономерный вопрос, который публичное обсуждение почти не затронуло: как они будут сосуществовать?

Ответ из текста проекта: закон не упоминает ЭПР напрямую и не описывает явного механизма интеграции. Это рождает три практических коллизии.

Коллизия 1: реестр доверенных моделей vs. ЭПР-участники. Многие компании в ЭПР работают с зарубежными или open-source моделями — именно потому что «песочница» позволяла это делать в экспериментальном режиме. После вступления закона в силу им придётся либо включить свои решения в реестр доверенных моделей (с прохождением ФСТЭК + ФСБ), либо выйти из регулируемых контуров. Переходного механизма законопроект не описывает.

Коллизия 2: обязанности оператора vs. ЭПР-режим. В действующих ЭПР компании работали по согласованным с Правительством специальным правилам, которые могли не совпадать с новыми обязанностями операторов из Статьи 10. Что главнее — индивидуальное ЭПР-постановление или рамочный закон? Иерархия не прописана.

Коллизия 3: ЭПР как будущая «песочница» для нового закона. Логика ЭПР — сначала эксперимент, потом регулирование. Логика нового закона — сначала рамка, потом подзаконные акты. Возникает риск «двойного слоя неопределённости»: компания находится в ЭПР (специальный режим) и одновременно ждёт подзаконных актов к рамочному закону. Что действует — непонятно обеим сторонам.

Экспериментальные режимы задумывались как полигон, где компании учатся работать с ИИ без страха нарушить закон. Новый закон создаёт ситуацию, когда правила полигона и правила «взрослого» регулирования ещё не сшиты между собой. Кто окажется в этом швe — узнаем после первого спорного случая.

Что делать практически: если ваша компания участвует в действующем ЭПР или планирует подать заявку, необходимо уже сейчас провести gap-анализ: какие ваши ЭПР-практики потребуют пересмотра под требования рамочного закона — по реестру, документированию, безопасности и локализации данных. Период до 1 сентября 2027 года — это не «запас времени», а окно для синхронизации двух правовых режимов, которую никто за вас не проведёт.

Что делать прямо сейчас — у вас есть год

| Роль | Действие #1 | Действие #2 | Действие #3 |

|---|---|---|---|

| Пользователь | Сохраните эту статью — она пригодится, когда придёт время требовать своих прав | Фиксируйте случаи, где ИИ принимает решения о вас без объяснений | Следите за выходом подзаконных актов |

| Оператор | Составьте журнал инцидентов и процедуру остановки системы | Назначьте ответственного за ИИ-безопасность | Опишите архитектуру и ограничения ваших систем |

| CIO/CDTO | Классифицируйте свои ИИ-системы по регуляторному риску | Проверьте vendor-стратегию на соответствие критериям суверенности | Заложите бюджет на регуляторную подготовку |

| Владелец/разработчик | Пересоберите пользовательское соглашение с учётом требований закона | Введите маркировку синтезированного контента | Документируйте источники данных для обучения |

Вместо заключения

Закон ещё не принят. Подзаконные акты ещё не написаны. Реестры ещё не работают. И именно поэтому сейчас — лучший момент для подготовки: пока правила игры можно ещё повлиять на формирование, а не только принимать как данность.

Участвуйте в общественном обсуждении на regulation.gov.ru. Оставляйте предложения. Читайте экспертные комментарии. ИИ будут регулировать так или иначе — вопрос только в том, кто сядет за стол, когда пишутся правила.

Проект ФЗ «Об основах государственного регулирования сфер применения технологий искусственного интеллекта в РФ» опубликован 18 марта 2026 года на regulation.gov.ru. Публичное обсуждение — до 15 апреля 2026 года. Планируемая дата вступления в силу — 1 сентября 2027 года.

Комментарии (1)

Пока тезисы это не только гильотина, но и полное непонимание законодателями происходящего. Для человека. “Вы можете потребовать сервис без ИИ”. У банка, например. По скоринговой модели. Ага, конечно. Автор попал пулей в пулю и выбрал пример, по которому уже сейчас банк на любой вопрос не ответит - НИЧЕГО. При этом «живых» скорингов давно ни у кого нет. Интересно что поменяется. «Маркировка дипфейков и синтезированного контента» - на сегодня нет инструментов, которые бы позволяли на 100% убедить, что это не дипфейк или не генерация. И станет толко сложнее. Для эксплуатанта особенно приятно: «Тестировать систему на возможность незаконного использования». Интересно почему до сих пор владельцы автомобилей не наказываются за угоны их машин … логика такая же. Для CIO и CEO - технологическое отставание в мире. «Компании с ресурсами для прохождения многоступенчатых согласований (реестр + ФСТЭК + ФСБ) получают конкурентное преимущество не через качество продукта, а через compliance-мощность.» и да и нет. В ГИСах и гос корпов - так и будет. А остальные будут использовать собственные юр лица - прокси в других странах и внутренние положения.